Crawl Budget ist kein Thema, über das jede kleine Website ständig nachdenken muss. Wenn neue Seiten schnell entdeckt werden und dein Projekt sauber aufgebaut ist, gibt es oft dringendere Baustellen. Anders sieht es aus, sobald viele Filterseiten, Parameter-URLs, alte Redirects, schwache Archivseiten oder unklare Signale ins Spiel kommen.

Dann passiert etwas ziemlich Simples: Google verschwendet Zeit auf die falschen URLs und kommt seltener bei den Seiten an, die Rankings, Leads oder Umsatz bringen.

Was Crawl Budget praktisch bedeutet

Google beschreibt Crawl Budget nicht als eine einzelne Kennzahl. Trotzdem gibt es in der Praxis eine klare Begrenzung: Nicht jede URL wird gleich oft, gleich schnell und mit derselben Priorität gecrawlt.

Entscheidend sind meistens zwei Dinge:

- wie viel Crawling dein Server sauber verkraftet

- wie stark Google den erneuten Besuch bestimmter URLs nachfragt

Wenn Website-Struktur, Performance und Priorisierung stimmen, funktioniert das recht gut. Wenn der Index voller Ballast ist, wird's ineffizient.

Wann du dich darum kümmern solltest

Typische Fälle:

- Shops mit Filtern und facettierter Navigation

- Verzeichnisse, Portale oder Marktplätze mit sehr vielen Detailseiten

- große Blogs mit viel altem, kaum gepflegtem Archivmaterial

- internationale Seiten mit vielen Sprach- und Ländervarianten

- JavaScript-lastige Websites

- Relaunches oder Migrationen mit Altlasten

Warnsignale sind zum Beispiel:

- wichtige Seiten werden nur langsam indexiert

- Search Console zeigt auffällig viel Crawling auf irrelevanten URLs

- Server-Logs sind voll mit 404ern, 5xx oder Redirect-Ketten

- Google verbringt viel Zeit auf Parametern statt auf Zielseiten

Wo Crawl Budget typischerweise verbrannt wird

Die Ursachen sind meist wenig spektakulär, aber teuer.

1. Langsame Server-Antwort

Ist TTFB hoch oder der Server unter Last instabil, drosselt Google oft automatisch.

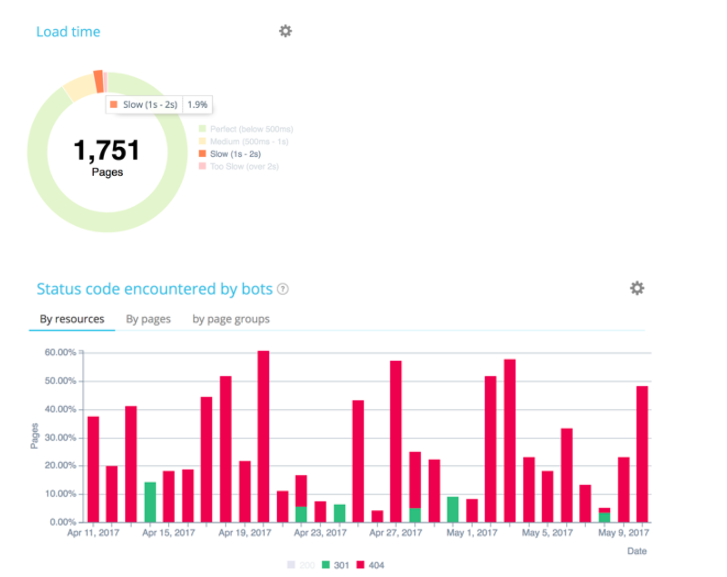

2. Fehlerhafte oder umgeleitete URLs

4xx, 5xx und unnötige 3xx-Ketten kosten Crawl-Zeit, ohne Indexwert zu liefern.

3. Doppelte oder fast doppelte Seiten

Filterparameter, Session-IDs, Sortierungen, HTTP/HTTPS-Duplikate oder schlampige Canonicals erzeugen mehr Crawl-Fläche, als du eigentlich brauchst.

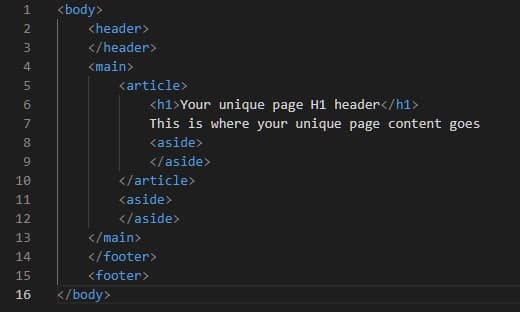

4. Schlechte interne Struktur

Seiten, die tief vergraben sind, senden kein Prioritätssignal. Für Google sind sie dann oft genau das: nachrangig.

5. Crawler-Fallen

Endlose Kalender, Facetten ohne Begrenzung, Suchergebnisseiten oder dynamisch generierte Routen, die keinen eigenen Wert haben.

Erst Technik und Performance sauberziehen

Bevor du über "mehr Crawl Budget" nachdenkst, solltest du Verschwendung entfernen.

- TTFB senken

- unnötige Redirects abbauen

- 4xx- und 5xx-Fehler beheben

- sicherstellen, dass zentrale Assets sauber mit 200 antworten

- prüfen, dass

robots.txtkeine wichtigen Ressourcen oder Bereiche falsch blockiert

Ein schneller Durchlauf im SEO Analyzer hilft, wiederkehrende technische Bremsen sichtbar zu machen. Wenn du Regeln für Bots sauber neu aufsetzen willst, ist der Robots.txt Generator der nächste sinnvolle Schritt.

Zeig Google klarer, welche Seiten wichtig sind

Google liest Priorität nicht aus deiner Wunschliste, sondern aus deinen Signalen.

Wichtige Seiten näher an die Oberfläche holen

Seiten mit Conversion- oder Traffic-Potenzial sollten nicht irgendwo im siebten Unterordner hängen.

- von Kategorien und Hub-Seiten aus verlinken

- interne Links aus starken Seiten nutzen

- Kernseiten nicht nur über zufällige Kontextlinks erreichbar machen

Sitemap bewusst pflegen

Deine XML-Sitemap sollte kein Sammelbecken für alles sein. Rein gehören die URLs, die du wirklich crawlen und indexieren lassen willst. Wenn das unübersichtlich geworden ist, kannst du sie mit dem Sitemap Generator neu strukturieren.

Orphan Pages finden

Orphan Pages leben oft noch über alte Links, externe Verweise oder die Sitemap. Ohne interne Verlinkung fehlt ihnen aber Kontext und interne Autorität. Wenn solche Seiten trotzdem Traffic ziehen, ist das ein klares Zeichen, dass du Strukturpotenzial verschenkst.

Canonicals und URL-Varianten konsequent bereinigen

Ein großer Teil des Crawl-Verlusts passiert, weil dieselbe Suchintention über mehrere URLs erreichbar ist.

Typische Kandidaten:

- Filter- und Sortierseiten

- Tracking-Parameter

- Duplikate mit und ohne Slash

- HTTP- und HTTPS-Versionen

- sehr ähnliche Kategorieseiten

Wenn Google mehrere Varianten wiederholt crawlt, obwohl am Ende nur eine indexiert werden soll, ist das verschwendete Energie. Prüfe die Signale bei Bedarf mit dem Canonical Tag Generator.

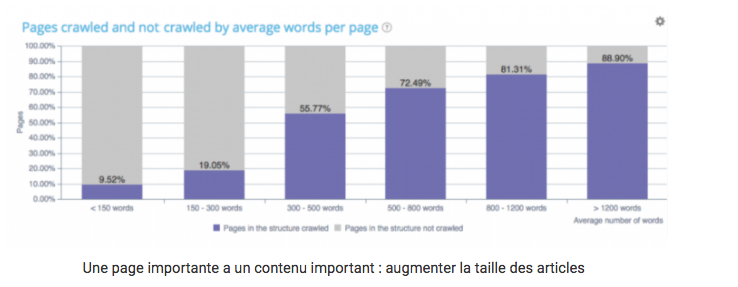

Auch Inhalt steuert, was häufiger gecrawlt wird

Google orientiert sich nicht nur an Technik, sondern auch daran, ob sich ein erneuter Besuch lohnt.

Sehr dünne, austauschbare oder veraltete Seiten senden selten starke Nachfrage-Signale. Nützliche, gepflegte Seiten deutlich eher.

Das heißt nicht, dass jede Seite künstlich länger werden muss. Es heißt nur: Kernseiten sollten Suchintention sauber beantworten und erkennbar gepflegt sein.

Sinnvolle Maßnahmen:

- schwache Doppelgänger zusammenführen

- wichtige Zielseiten aktualisieren

- wertlose Alt-URLs löschen oder weiterleiten

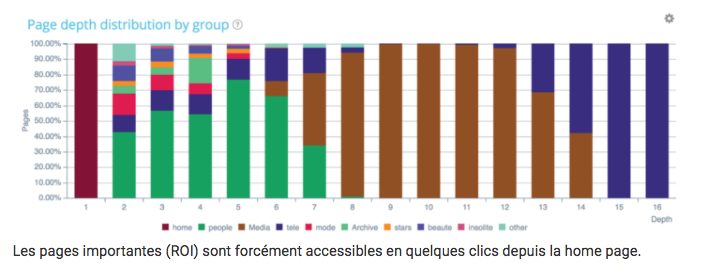

Seitentiefe ist ein unterschätztes Signal

Wenn wichtige Seiten zu tief im Klickpfad liegen, bekommen sie seltener interne Signale und oft auch weniger Crawling.

Gerade bei aktiven Seiten oder Money Pages lohnt sich deshalb ein Blick auf die Struktur:

- thematische Hubs aufbauen

- starke Kategorien als Verteiler nutzen

- HTML-Sitemap für tiefe Cluster ergänzen

- nicht alles über interne Suche oder JS-Filter verstecken

Ein pragmischer Maßnahmenplan

Wenn du Crawl Budget systematisch verbessern willst, arbeite in dieser Reihenfolge:

- Crawl-Statistiken in Search Console prüfen.

- Server-Logs analysieren, wenn genug Traffic da ist.

- Fehlercodes und Redirect-Ketten bereinigen.

- Doppelte URL-Muster und Canonicals korrigieren.

- Parametermüll und Crawler-Fallen reduzieren.

- Interne Links zu wichtigen Seiten ausbauen.

- Sitemap an echte Prioritäten anpassen.

- Schwache Inhalte konsolidieren, starke Inhalte aktuell halten.

Kurz gesagt

Crawl Budget zu optimieren heißt nicht, Google "zu mehr Crawling zu überreden". Es heißt, unnötige Hindernisse und irrelevante URLs aus dem Weg zu räumen, damit der Bot öfter bei den Seiten landet, die wirklich zählen.

Weniger Ballast, klarere Prioritäten, bessere interne Wege. Meistens kommt der Effekt genau daher.