Не каждому сайту нужно жить в тревоге из-за crawl budget. Если проект небольшой, структура у него чистая, а новые страницы быстро попадают в поле зрения Google, это редко самая острая проблема.

Но как только сайт начинает обрастать фильтрами, параметрами, старыми редиректами, тонкими страницами и дублями, ситуация меняется. Googlebot начинает тратить время не там, где нужно.

По сути, речь идёт об эффективности: чем больше обход уходит на шумовые URL, тем меньше внимания получают страницы, которые приносят трафик, лиды и деньги.

Что такое crawl budget на практике

Google давно говорит, что crawl budget нельзя свести к одной единственной метрике. Но в реальной работе всё довольно понятно: разные URL сканируются с разной частотой и приоритетом.

Обычно работают две силы:

- сколько сайт способен выдержать без просадки по скорости и стабильности

- насколько Google считает нужным вернуться к конкретным URL

Если архитектура сайта понятная, а техническая база чистая, проблем меньше. Если сайт производит слишком много мусорных состояний, crawl budget расползается.

Когда об этом действительно стоит думать

Тема становится важной, если у вас:

- интернет-магазин с фильтрами и фасетной навигацией

- каталог, маркетплейс или большой справочник

- блог с огромным архивом старых материалов

- мультиязычный или мультирегиональный сайт

- тяжёлая JS-архитектура

- последствия миграции или редизайна

Типичные признаки:

- важные страницы индексируются медленно

- в Search Console видно много обхода по второстепенным URL

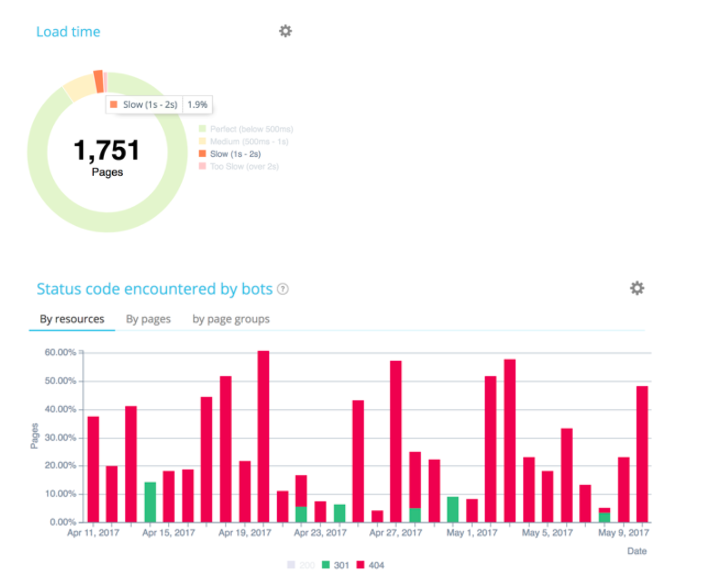

- в логах сервера много 404, 5xx и цепочек редиректов

- Google чаще ходит по вариациям URL, чем по ключевым посадочным страницам

Где чаще всего теряется crawl budget

Обычно причина не в одной большой поломке, а в наборе системных утечек.

1. Медленный сервер

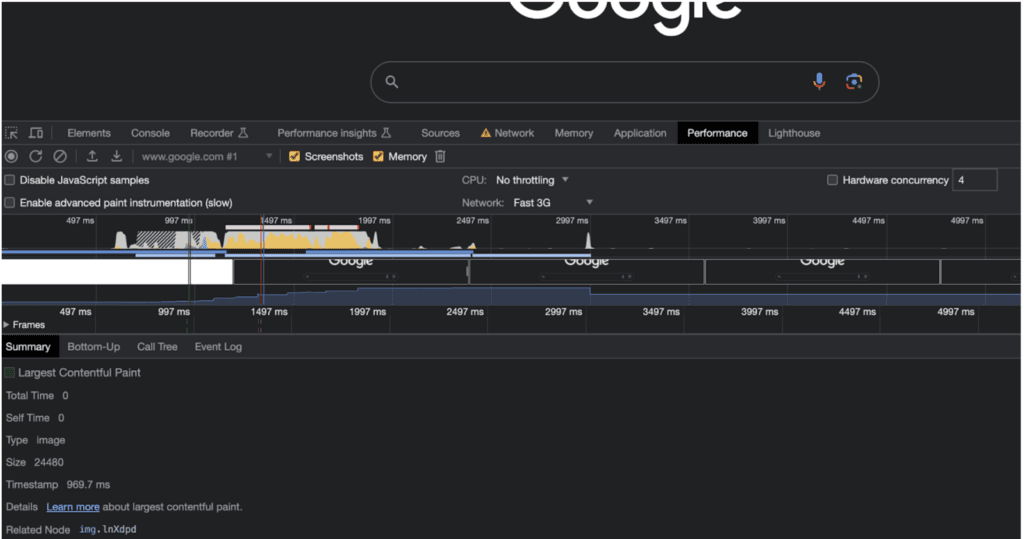

Если TTFB высокий или сервер ведёт себя нестабильно под нагрузкой, Google обычно сам снижает темп.

2. Ошибки и лишние редиректы

4xx, 5xx и цепочки вида A -> B -> C тратят обход впустую.

3. Дубли и почти дубли

Фильтры, параметры, страницы сортировки, tracking-метки, неразобранные HTTP/HTTPS-версии, плохие canonical-сигналы.

4. Слабая внутренняя структура

Если страница спрятана слишком глубоко, она выглядит для Google второстепенной.

5. Ловушки для краулера

Бесконечные календари, поисковая выдача внутри сайта, бесконечные комбинации фильтров и динамические маршруты без ценности.

Начинать нужно с техники и скорости

Прежде чем пытаться "добавить" crawl budget, лучше перестать его терять.

- снизить TTFB

- убрать ненужные редиректы

- исправить повторяющиеся 4xx и 5xx

- убедиться, что важные CSS, JS и изображения отдают 200

- проверить, не блокирует ли

robots.txtнужные ресурсы

SEO Analyzer помогает быстро увидеть повторяющиеся технические проблемы. Если нужно заново навести порядок в правилах доступа для ботов, пригодится и Robots.txt Generator.

Помогите Google быстрее понять, какие страницы главные

Google считывает приоритет не из презентации, а из структуры сайта.

Поднимите важные страницы ближе к верхнему уровню

Страницы, которые приносят бизнес-результат, не должны быть спрятаны глубоко.

- усиливайте их ссылками из категорий и хабов

- ведите на них ссылки с сильных страниц

- не оставляйте их зависеть от случайных контекстных ссылок

Держите sitemap под контролем

XML sitemap не должен быть складом всех существующих URL. Туда лучше включать только то, что вы действительно хотите сканировать и индексировать. Если карта сайта расползлась, её стоит пересобрать через Sitemap Generator.

Найдите orphan pages

Orphan pages могут жить за счёт старых ссылок или sitemap, но без внутренней перелинковки они структурно слабы. Если такая страница ещё и приносит трафик, значит вы теряете полезный актив.

Canonical и вариации URL: тихий пожиратель обхода

Очень много crawl budget уходит на то, что одна и та же интентная страница существует в нескольких версиях.

Проверяйте в первую очередь:

- фильтры и сортировки

- параметризованные URL кампаний

- версии со слешем и без

- HTTP и HTTPS

- слишком похожие категории или подборки

Если Google сканирует несколько версий, а индексировать должен одну, это уже перерасход. Такие сигналы удобно перепроверять через Canonical Tag Generator.

Контент тоже влияет на частоту обхода

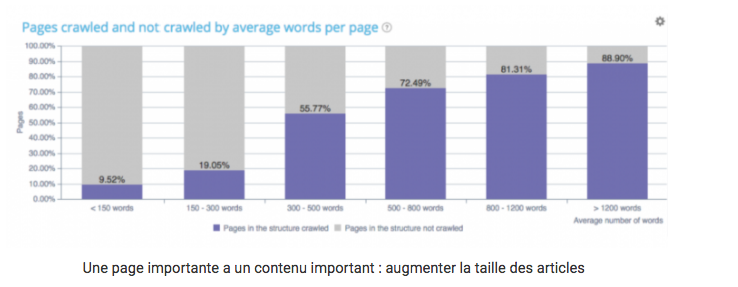

Google ориентируется не только на технику. Он ещё и оценивает, есть ли смысл возвращаться к странице.

Тонкие, шаблонные или заброшенные URL получают слабый спрос на повторный обход. Содержательные и поддерживаемые страницы обычно выигрывают.

Это не значит, что нужно бессмысленно раздувать тексты. Это значит:

- объединять слабые дубли

- обновлять важные посадочные страницы

- удалять или перенаправлять URL без реальной пользы

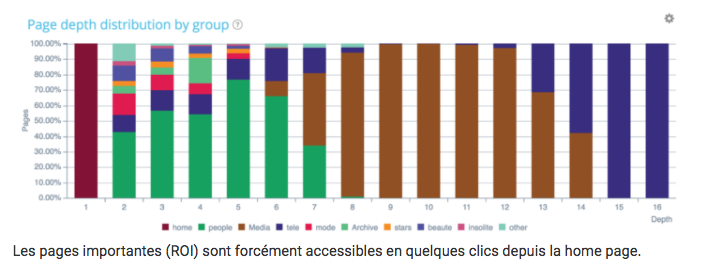

Глубина страницы до сих пор остаётся сильным сигналом

Если до страницы нужно добраться через 12-15 кликов, она вряд ли выглядит для Google как приоритет.

Если активные или денежные страницы зарыты слишком глубоко, архитектуру стоит пересобрать:

- сделать тематические хабы

- усилить верхние категории

- добавить HTML sitemap для глубоких разделов

- не прятать важное только за внутренним поиском или JS-фильтрами

Практический порядок действий

- Посмотрите crawl-статистику в Search Console.

- Разберите серверные логи, если сайт уже масштабный.

- Почистите ошибки и цепочки редиректов.

- Уберите дубли и выровняйте canonical.

- Сократите параметрический мусор и crawler traps.

- Усильте внутренние ссылки на ключевые страницы.

- Приведите sitemap в соответствие с приоритетами.

- Консолидируйте слабые страницы и поддерживайте сильные в актуальном состоянии.

Главное

Оптимизация crawl budget — это не попытка "заставить Google ходить чаще" ради красивой идеи. Это работа по устранению лишних URL, технического трения и неясных сигналов, чтобы обход доставался именно тем страницам, которые для вас важны.

Меньше шума, чище структура, сильнее фокус на приоритетных URL. Обычно этого уже достаточно, чтобы ситуация заметно улучшилась.