모든 사이트가 크롤링 예산을 최우선 과제로 볼 필요는 없습니다. 페이지 수가 많지 않고, 새 URL도 금방 발견되며, 구조도 단순하다면 더 급한 SEO 이슈가 있을 수 있습니다.

문제는 사이트가 커지면서 시작됩니다. 필터 URL, 파라미터 페이지, 낡은 리다이렉트, 약한 아카이브, 중복성 높은 페이지가 쌓이기 시작하면 구글봇은 점점 엉뚱한 곳에 시간을 씁니다.

결국 핵심은 간단합니다. 중요한 페이지에 써야 할 크롤링이 덜 중요한 URL에 새고 있다는 뜻입니다.

크롤링 예산이 실제로 의미하는 것

구글은 오래전부터 "crawl budget"을 하나의 단일 지표로 설명하지 않았습니다. 그래도 실무에서는 분명한 현실이 있습니다. 모든 URL이 같은 빈도와 우선순위로 크롤되지 않는다는 점입니다.

보통은 두 가지가 함께 작동합니다.

- 서버가 안정적으로 감당할 수 있는 크롤링량

- 구글이 특정 URL을 다시 방문할 필요성을 얼마나 느끼는지

사이트가 빠르고 구조가 명확하면 큰 문제가 없습니다. 반대로 잡음이 많으면 크롤링이 흩어집니다.

이런 사이트라면 신경 써야 합니다

크롤링 예산 최적화가 특히 중요한 경우는 대체로 아래와 같습니다.

- 필터와 정렬 옵션이 많은 쇼핑몰

- 디렉터리, 마켓플레이스, 대규모 카탈로그

- 오래된 글이 많은 블로그나 미디어

- 다국어, 다국가 사이트

- JavaScript 의존도가 높은 구조

- 마이그레이션 이후 찌꺼기 URL이 남은 사이트

이런 징후도 함께 보이면 더 분명합니다.

- 중요한 페이지가 늦게 색인된다

- Search Console에서 비핵심 URL에 크롤링이 많이 잡힌다

- 서버 로그에 404, 5xx, 리다이렉트 체인이 많다

- 구글이 매출 페이지보다 잡음성 URL을 더 자주 본다

크롤링 예산을 가장 많이 잡아먹는 것들

대부분의 문제는 꽤 익숙한 곳에서 나옵니다.

1. 느린 서버 응답

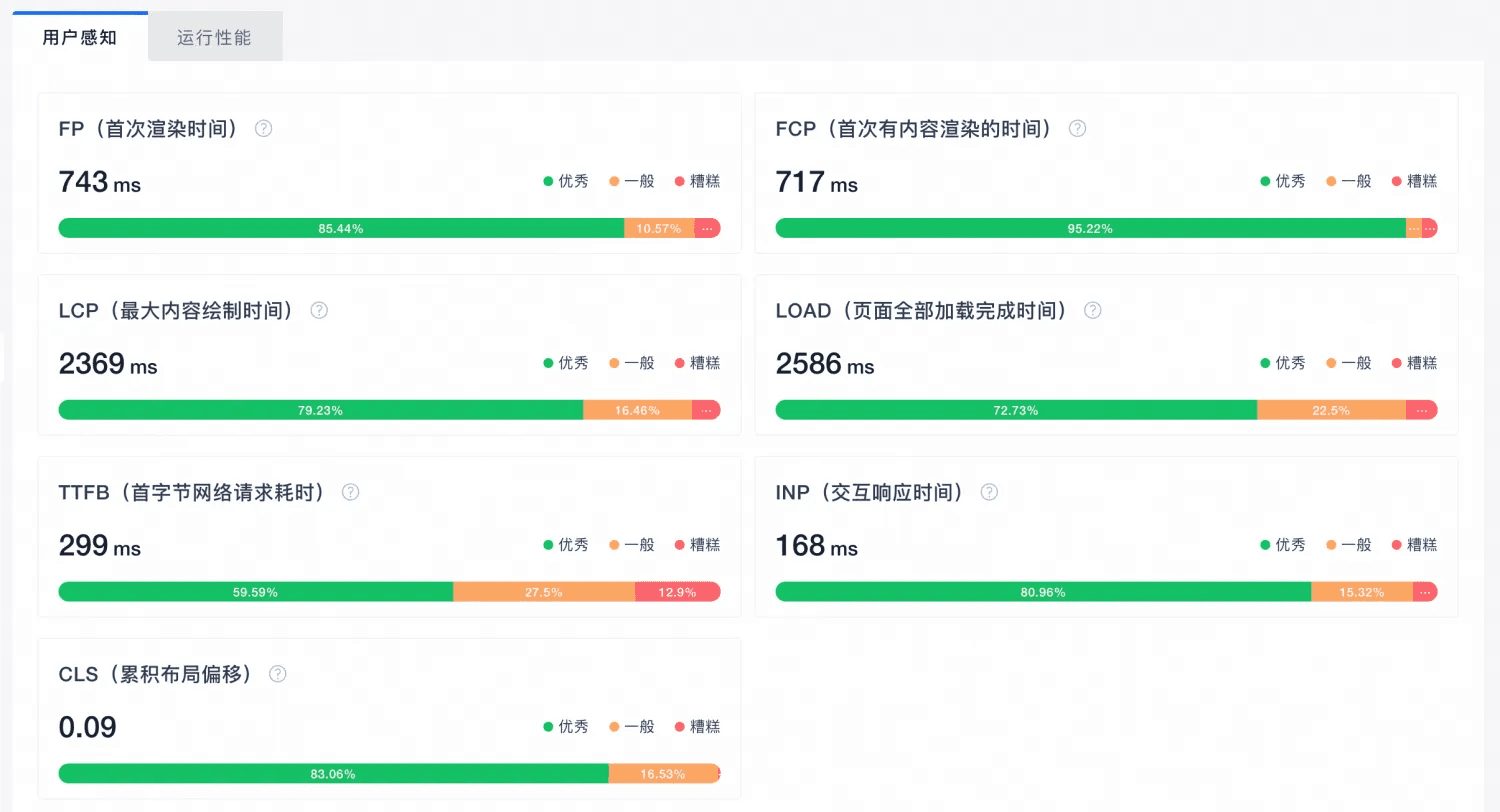

TTFB가 높거나 서버가 불안정하면 구글은 자연스럽게 속도를 낮춥니다.

2. 오류 페이지와 리다이렉트 체인

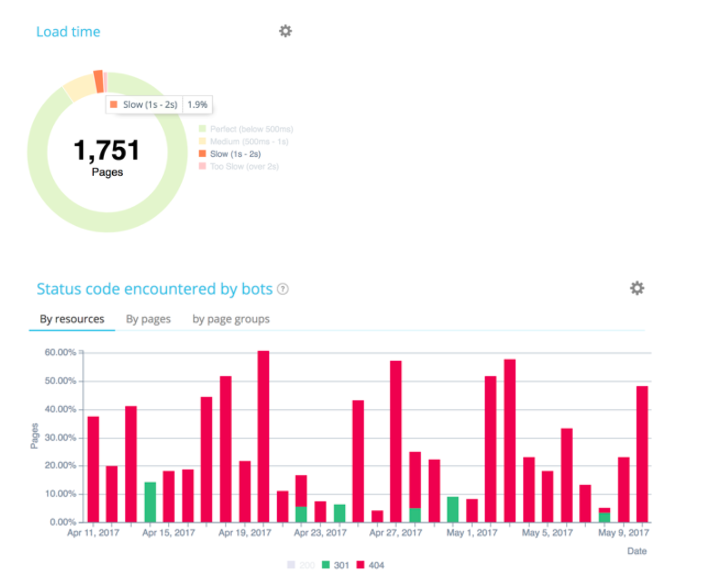

4xx, 5xx, A -> B -> C 같은 구조는 크롤링을 낭비할 뿐입니다.

3. 중복 또는 유사 URL

필터, 파라미터, 정렬 페이지, 트래킹 URL, HTTP/HTTPS 중복, 잘못된 canonical이 대표적입니다.

4. 약한 내부 링크 구조

깊숙이 묻힌 페이지는 구글 입장에서도 우선순위가 낮아 보입니다.

5. 크롤러 트랩

무한 캘린더, 끝없는 조합형 필터, 색인 가능한 내부 검색 결과, 가치 없는 동적 경로가 여기에 들어갑니다.

먼저 기술 건강과 속도부터 정리하세요

크롤링 예산을 늘리려 하기 전에, 지금 새는 곳을 막는 편이 훨씬 효과적입니다.

- TTFB를 낮춥니다

- 불필요한 리다이렉트를 줄입니다

- 반복되는 4xx와 5xx를 고칩니다

- CSS, JS, 이미지 같은 핵심 리소스가 200으로 응답하는지 봅니다

robots.txt가 중요한 리소스를 막고 있지 않은지 확인합니다

SEO Analyzer로 사이트 전반의 기술적 낭비를 먼저 훑어보면 우선순위가 빨리 잡힙니다. Robots 규칙 정리가 필요하면 Robots.txt 생성기도 같이 쓰면 됩니다.

구글에게 어떤 페이지가 중요한지 더 선명하게 보여주세요

구글은 "이 페이지가 중요합니다"라는 선언문을 믿지 않습니다. 구조와 링크를 봅니다.

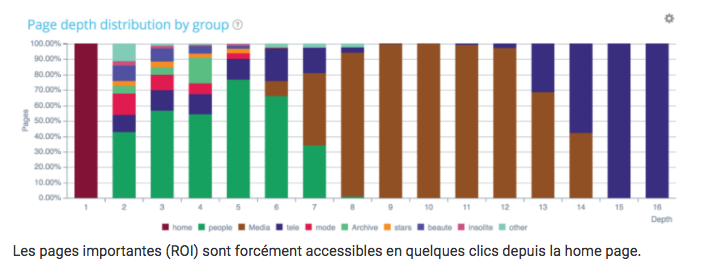

핵심 페이지를 얕은 깊이에 배치하세요

트래픽을 만들거나 전환을 담당하는 페이지가 너무 깊숙하면 안 됩니다.

- 카테고리나 허브 페이지에서 링크합니다

- 강한 페이지에서 내부 링크를 보냅니다

- 우연한 본문 링크 하나에만 의존하지 않습니다

XML 사이트맵을 선별적으로 관리하세요

사이트맵은 존재하는 모든 URL의 목록이 아닙니다. 정말 크롤링하고 색인되길 원하는 URL 중심으로 관리해야 합니다. 구조가 흐트러졌다면 사이트맵 생성기로 다시 정리할 수 있습니다.

고아 페이지를 찾으세요

고아 페이지는 예전 링크나 사이트맵을 통해 구글이 접근할 수는 있어도, 내부 링크가 없어서 구조적 우선순위가 낮습니다. 그런데도 트래픽이 있다면 더 아깝습니다. 가치 있는 페이지가 메인 발견 경로 바깥에 있다는 뜻이니까요.

Canonical과 중복 URL 정리는 조용하지만 큰 차이를 만듭니다

크롤링 예산 손실은 비슷한 페이지가 여러 URL로 열리는 순간부터 커집니다.

우선 점검할 것:

- 필터와 정렬 URL

- 캠페인 파라미터

- 슬래시 유무 중복

- HTTP와 HTTPS 중복

- 지나치게 유사한 카테고리 페이지

여러 버전을 크롤하고 결국 하나만 남기는 구조라면 이미 낭비가 발생하고 있습니다. 이런 신호는 Canonical Tag Generator로 다시 점검할 수 있습니다.

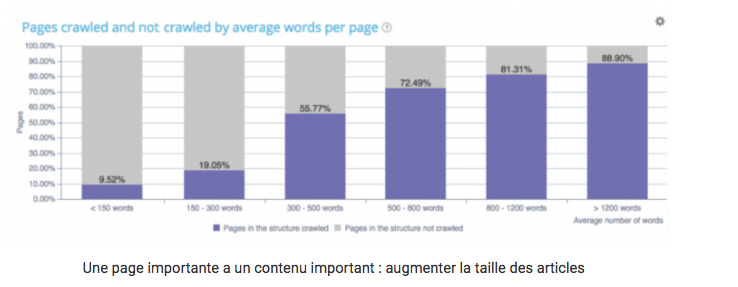

콘텐츠 품질도 크롤링 빈도에 영향을 줍니다

구글은 기술적 구조만 보는 것이 아니라, 다시 방문할 가치가 있는지도 봅니다.

얇고 반복적이며 방치된 페이지는 우선순위가 떨어집니다. 반대로 잘 정리되고 업데이트되는 페이지는 다시 볼 이유가 생깁니다.

그래서 필요한 건 단순한 글자 수 늘리기가 아닙니다.

- 약한 중복 페이지는 합치고

- 핵심 페이지는 최신 상태로 유지하고

- 가치 없는 URL은 정리하는 것

페이지 깊이는 여전히 강한 우선순위 신호입니다

홈에서 10번 넘게 클릭해야 겨우 도달하는 페이지를 구글이 핵심 자산으로 보기 어렵습니다.

특히 활성 페이지나 매출 페이지가 너무 깊다면 구조를 손봐야 합니다.

- 주제별 허브를 만들고

- 상위 카테고리에서 더 잘 연결하고

- 깊은 페이지 묶음에는 HTML 사이트맵을 추가하고

- 내부 검색이나 JS 필터 뒤에 핵심 콘텐츠를 숨기지 않는 것

바로 실행할 수 있는 순서

- Search Console의 크롤링 통계를 확인합니다.

- 충분한 규모라면 서버 로그를 분석합니다.

- 오류 코드와 리다이렉트 체인을 정리합니다.

- 중복 URL과 canonical을 정리합니다.

- 파라미터 쓰레기와 크롤러 트랩을 줄입니다.

- 중요한 페이지를 향한 내부 링크를 강화합니다.

- 사이트맵을 실제 우선순위에 맞춥니다.

- 약한 페이지는 통합하고 강한 페이지는 업데이트합니다.

정리하면

크롤링 예산 최적화는 구글에게 "더 많이 와달라"고 요청하는 작업이 아닙니다. 쓸데없는 URL과 기술적 마찰을 치워서, 구글이 정말 중요한 페이지를 더 자주 보게 만드는 작업에 가깝습니다.

잡음을 줄이고, 구조를 선명하게 만들고, 핵심 페이지를 위로 끌어올리세요. 실제 효과는 대개 거기서 나옵니다.