Tout le monde parle de crawl budget comme s’il s’agissait d’un sujet critique pour chaque site. En réalité, ce n’est pas vrai. Un petit site propre, avec peu d’URLs et des pages découvertes rapidement, n’a généralement pas besoin d’en faire une obsession.

Le problème apparaît quand le site grossit, quand il multiplie les filtres, les paramètres, les redirections anciennes, les pages quasi identiques ou les archives peu utiles. À ce moment-là, Googlebot commence à dépenser du temps là où il ne devrait pas.

Ce que signifie vraiment le crawl budget

Google explique depuis longtemps qu’il n’existe pas une seule métrique qui résume entièrement le crawl budget. En pratique, pourtant, la logique est simple: Google ne peut pas tout crawler avec la même fréquence.

Deux éléments pèsent surtout:

- la capacité de ton site à encaisser le crawl sans ralentir

- l’intérêt perçu par Google à revenir sur certaines URLs

Quand la technique est propre et que la hiérarchie est lisible, Google revient au bon endroit. Quand le site génère du bruit, le crawl se disperse.

Quand il faut vraiment s’en préoccuper

Le sujet devient concret si ton site ressemble à l’un de ces cas:

- e-commerce avec navigation à facettes

- annuaire, marketplace ou catalogue massif

- blog avec beaucoup d’archives vieillissantes

- site international avec de nombreuses variantes

- architecture très dépendante de JavaScript

- migration laissant derrière elle des duplicats et des redirections

Les signaux qui doivent alerter:

- les pages importantes s’indexent lentement

- Search Console montre beaucoup d’activité sur des URLs secondaires

- les logs serveur révèlent une forte part de 404, 5xx ou redirections

- Google revisite des pages sans enjeu plus souvent que tes pages business

Là où le crawl budget se gaspille le plus

Le plus souvent, les pertes viennent de quelques problèmes assez classiques.

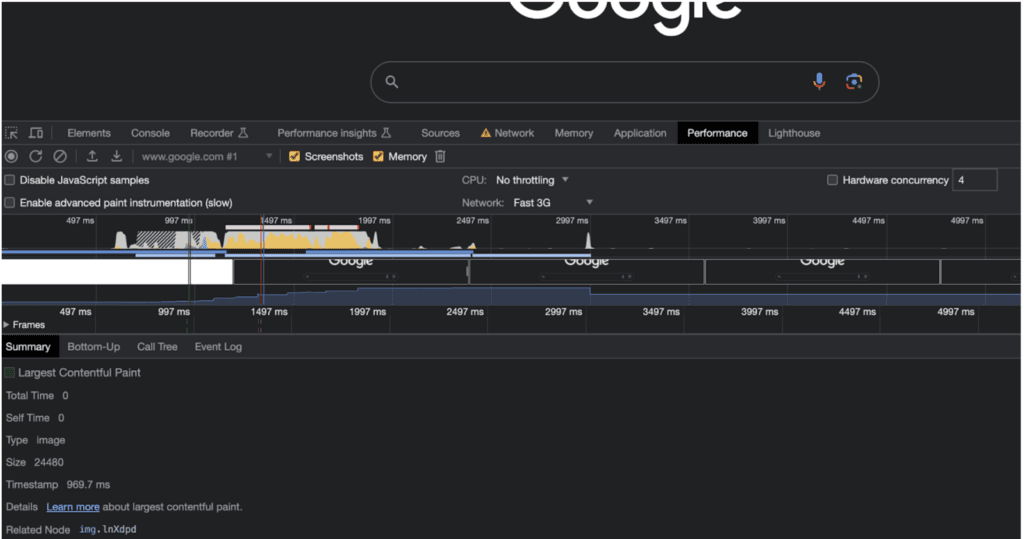

1. Un serveur lent

Si le TTFB grimpe ou si le serveur tient mal la charge, Google réduit souvent la voilure.

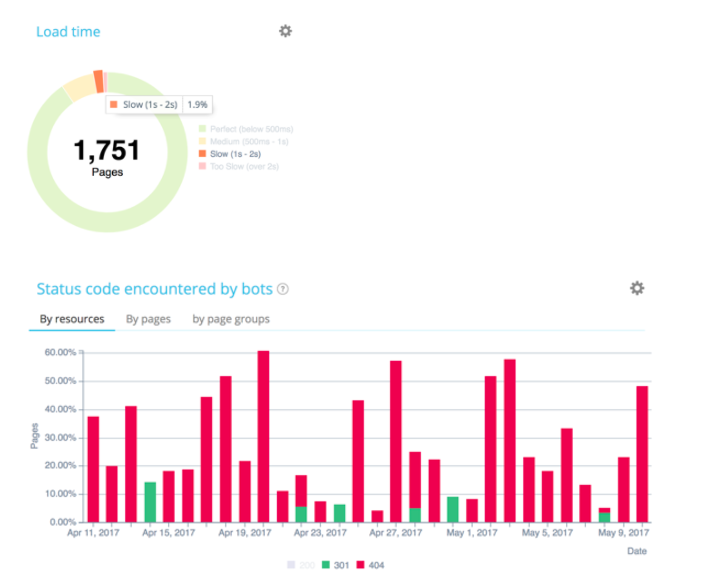

2. Des erreurs et redirections en série

Les 4xx, 5xx et chaînes de redirection consomment du crawl sans produire de valeur.

3. Des variantes d’URL trop nombreuses

Paramètres, filtres, tracking, versions HTTP/HTTPS, slash incohérents, catégories proches. Tout cela augmente artificiellement la surface à crawler.

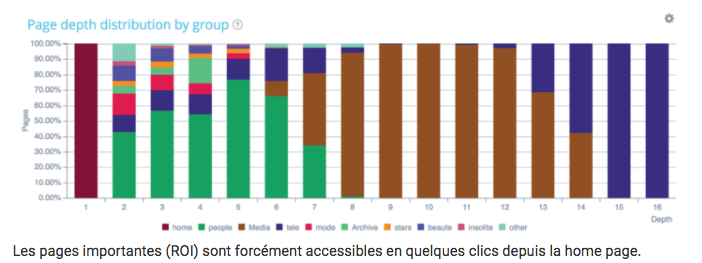

4. Une mauvaise distribution des liens internes

Plus une page est profonde, plus le signal de priorité s’affaiblit.

5. Des pièges à crawler

Calendriers infinis, facettes sans contrôle, moteurs de recherche internes indexables, routes générées sans fin.

Commence par la base: performance et santé technique

Avant de chercher à "gagner" du crawl budget, il faut arrêter d’en perdre.

- baisse le TTFB

- supprime les redirections inutiles

- corrige les 4xx et 5xx persistants

- vérifie que les ressources importantes renvoient bien 200

- contrôle que

robots.txtne bloque pas ce qui doit être rendu

Un passage dans SEO Analyzer aide à repérer rapidement les freins techniques récurrents. Si tes règles de crawl sont désordonnées, tu peux aussi repartir proprement avec le Générateur de Robots.txt.

Donne à Google une carte plus lisible de tes priorités

Google ne lit pas tes intentions; il lit la structure du site.

Rapproche les pages importantes

Les pages qui convertissent, vendent ou captent une forte intention de recherche ne devraient pas être enfouies trop loin.

- relie-les depuis la navigation ou les hubs

- renforce-les depuis des pages déjà fortes

- évite qu’elles ne dépendent uniquement d’un maillage contextuel faible

Garde un sitemap sélectif

Un sitemap XML n’est pas fait pour empiler toutes les URLs possibles. Il doit surtout refléter ce que tu veux vraiment faire crawler et indexer. Si nécessaire, reconstruis-le avec le Générateur de Sitemap.

Traque les pages orphelines

Une page orpheline peut encore recevoir des visites de Google via d’anciens liens ou le sitemap. Mais sans maillage interne, elle reste structurellement faible. Si elle apporte du trafic, tu rates une occasion claire de mieux l’exploiter.

Canonical, paramètres et duplicats: le chantier silencieux

Une grande partie du gaspillage de crawl vient du fait que plusieurs URLs racontent presque la même chose.

À revoir en priorité:

- pages filtrées ou triées

- paramètres de campagne

- doublons avec et sans slash

- HTTP versus HTTPS

- pages de catégories très proches

Si plusieurs variantes sont crawlées alors qu’une seule devrait faire autorité, tu dépenses du budget pour rien. Vérifie ces signaux avec le Générateur de balise Canonical si besoin.

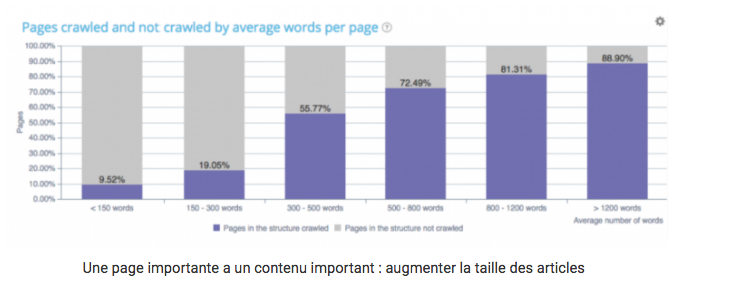

Le contenu influence aussi la fréquence de crawl

Google ne revient pas au hasard. Il essaie aussi d’estimer si la revisite vaut la peine.

Les pages très maigres, très répétitives ou laissées à l’abandon ont rarement la priorité. Les pages utiles, substantielles et maintenues, beaucoup plus.

Le but n’est pas d’allonger artificiellement tous les textes. Le but est de renforcer les pages importantes:

- fusionner les contenus faibles qui se cannibalisent

- mettre à jour les pages stratégiques

- supprimer ou rediriger les URLs sans vraie valeur

La profondeur de page reste un signal fort

Une page à 12 ou 15 clics de l’accueil n’envoie pas exactement un message de priorité.

Si tes pages actives ou tes pages business sont trop profondes, il faut remonter leur visibilité structurelle:

- créer des hubs thématiques

- renforcer les catégories mères

- ajouter un sitemap HTML pour les ensembles profonds

- éviter de cacher l’essentiel derrière la recherche interne ou des filtres JS

Une feuille de route simple

Pour remettre de l’ordre, avance dans cet ordre:

- Analyse les stats de crawl dans Search Console.

- Regarde les logs serveur si le site a assez de volume.

- Corrige les erreurs et chaînes de redirection.

- Réduis les duplicats et clarifie les canonicals.

- Nettoie les pièges à crawler et les paramètres inutiles.

- Renforce le maillage interne vers les pages qui comptent.

- Aligne le sitemap avec tes vraies priorités.

- Consolide les pages faibles et maintiens les bonnes pages à jour.

Ce qu’il faut retenir

Optimiser le crawl budget ne consiste pas à chercher "plus de crawl" pour le principe. Il s’agit surtout de retirer les URLs inutiles, les frictions techniques et les signaux confus pour que Google passe plus souvent sur les bonnes pages.

Moins de gaspillage, plus de clarté, une architecture plus nette. C’est généralement là que le gain se joue.