No todas las webs tienen que obsesionarse con el crawl budget. Si tu sitio es pequeño, limpio y Google descubre tus URLs nuevas enseguida, seguramente no es tu mayor problema. Pero cuando empiezan a aparecer filtros, parámetros, paginaciones interminables, redirecciones viejas o cientos de páginas flojas, el rastreo se vuelve un cuello de botella real.

Dicho de forma simple: si Googlebot gasta tiempo en páginas equivocadas, visita menos las páginas que sí te traen negocio.

Qué es de verdad el crawl budget

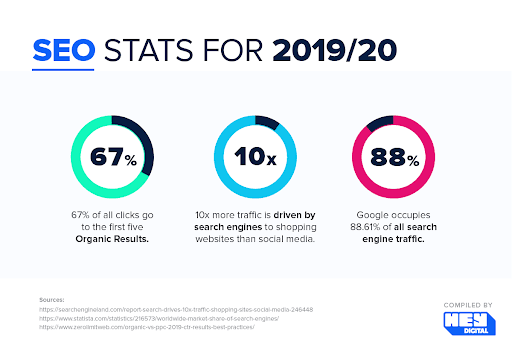

Google lleva años diciendo que el "crawl budget" no es una métrica única y que muchos sitios pequeños no necesitan preocuparse demasiado. Aun así, en la práctica sí existe un límite operativo: Google no rastrea todo con la misma frecuencia ni con la misma urgencia.

Normalmente intervienen dos fuerzas:

- cuánto puede rastrear sin castigar a tu servidor

- cuánto le interesa volver a rastrear ciertas URLs

Cuando el sitio responde bien y deja claro qué páginas son importantes, el rastreo fluye. Cuando el sitio está lleno de ruido, se desperdicia.

Cuándo sí deberías prestarle atención

El problema suele aparecer en webs con alguna de estas señales:

- ecommerce con filtros y URLs parametrizadas

- directorios o marketplaces con miles de fichas

- blogs o medios con mucho archivo viejo y poco mantenido

- sitios internacionales con muchas variantes

- proyectos muy apoyados en JavaScript

- migraciones donde quedaron redirecciones, duplicados o URLs huérfanas

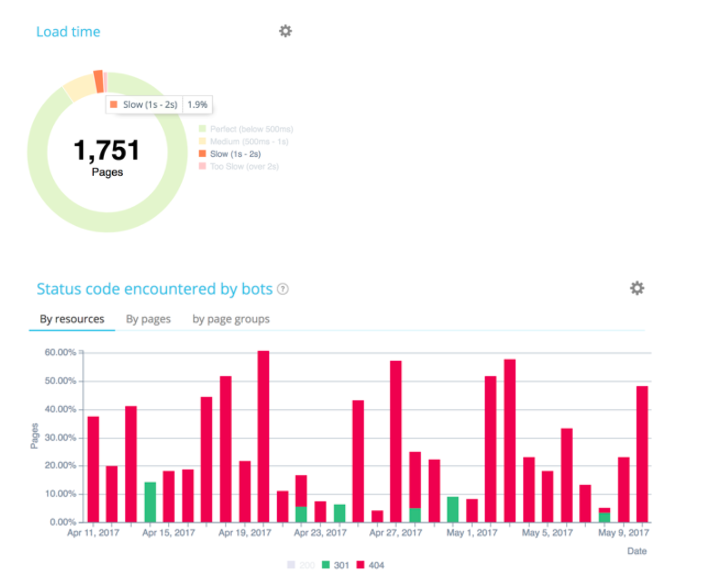

Si notas que páginas importantes tardan en indexarse, que Search Console muestra mucho rastreo sobre URLs irrelevantes o que tus logs están llenos de 404 y cadenas de redirección, ya tienes una pista.

Los mayores agujeros por donde se escapa el crawl budget

La mayoría de los problemas vienen de lo mismo de siempre. No es un misterio.

1. Respuesta lenta del servidor

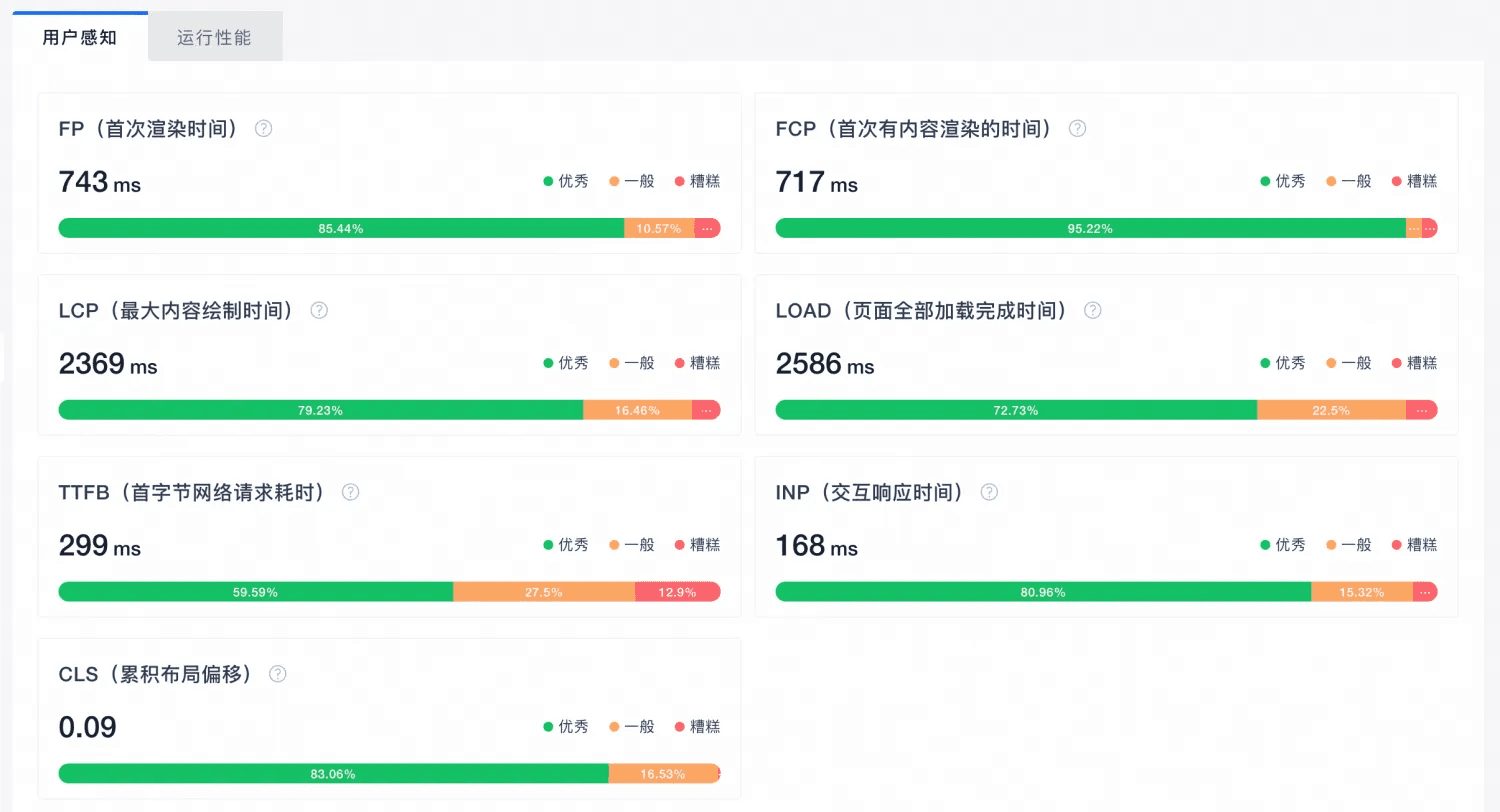

Si tu TTFB es alto o el servidor falla cuando Google aprieta el ritmo, el bot reduce la intensidad.

2. Errores y redirecciones innecesarias

Un volumen alto de 4xx, 5xx o cadenas tipo A -> B -> C hace que el rastreo pierda tiempo donde no aporta nada.

3. URLs duplicadas o casi duplicadas

Parámetros, filtros, sesiones, búsquedas internas, versiones HTTP/HTTPS mal resueltas, canonicals inconsistentes. Todo eso crea más superficie de rastreo de la que realmente necesitas.

4. Mala arquitectura interna

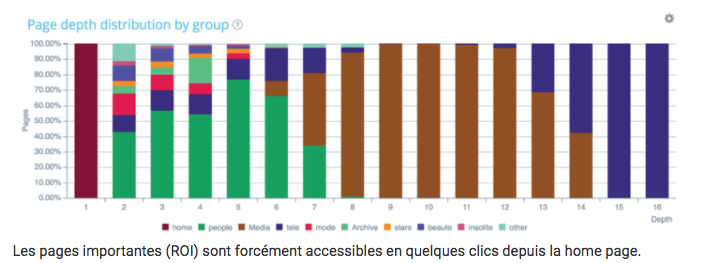

Si una página clave está a 12 clics de la home, Google recibe un mensaje claro: no es prioritaria.

5. Trampas para rastreadores

Calendarios infinitos, facetas sin control, espacios de navegación interminables o rutas generadas por JS que no aportan nada.

Primero arregla velocidad y salud técnica

Si quieres mejorar el crawl budget, empieza por lo menos glamuroso:

- reduce el TTFB

- elimina redirecciones innecesarias

- corrige 4xx y 5xx persistentes

- asegúrate de que CSS, JS e imágenes críticas devuelvan 200

- revisa que

robots.txtno bloquee recursos importantes

Una revisión rápida con SEO Analyzer te sirve para localizar errores técnicos repetidos antes de entrar en análisis más finos.

Si además necesitas rehacer reglas de acceso para bots, apóyate en el Generador de Robots.txt.

Dale a Google un mapa más claro de tus páginas importantes

Google no decide la prioridad por arte de magia. La deduce de tus señales internas.

Acerca tus páginas clave a la superficie

Las URLs que convierten, atraen negocio o responden a búsquedas con intención alta no deberían estar enterradas.

- súbelas en navegación, categorías o hubs

- enlázalas desde páginas fuertes

- evita que dependan solo de breadcrumbs o enlaces contextuales aislados

Cuida el sitemap XML

Tu sitemap no debería ser un vertedero de URLs. Incluye lo que sí merece ser rastreado e indexado. Si la estructura está desordenada, reházala con el Generador de Sitemap.

Busca páginas huérfanas

Una página sin enlaces internos puede seguir viva por enlaces antiguos o por el sitemap, pero para Google es una señal débil. Si además trae tráfico, el problema es todavía más serio: tienes una URL útil fuera de tu sistema principal de descubrimiento.

Canonicals y duplicados: donde más rastreo se pierde sin darte cuenta

En muchas webs el crawl budget no se rompe por falta de contenido, sino por exceso de versiones.

Revisa:

- páginas con filtros y ordenaciones

- URLs con parámetros de tracking

- versiones con y sin slash

- HTTP frente a HTTPS

- categorías o fichas muy parecidas

Si varias versiones compiten entre sí, Google las rastrea aunque luego solo quiera una. Ahí conviene validar las señales con el Generador de Etiquetas Canonical.

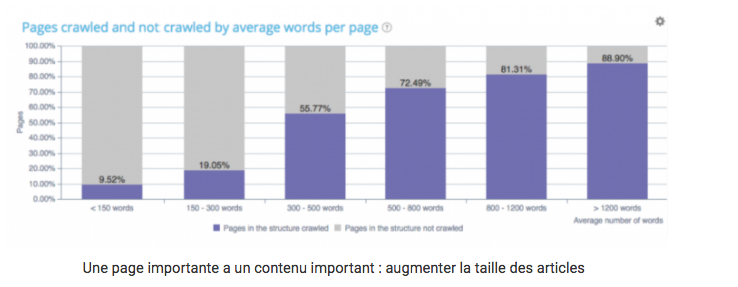

El contenido también pesa

Google no reparte el rastreo solo por jerarquía técnica. También intenta entender qué merece la pena revisar una y otra vez.

Las páginas finas, repetidas o abandonadas no ayudan. Las páginas útiles, actualizadas y con demanda real sí.

No se trata de inflar textos. Se trata de que tus páginas importantes tengan suficiente profundidad para resolver la intención de búsqueda y justificar revisitas.

En la práctica:

- fusiona páginas débiles que compiten por lo mismo

- actualiza contenido estratégico que sí convierte

- elimina o redirige URLs sin valor real

La profundidad importa más de lo que parece

Cuando una URL está demasiado lejos de la home, suele recibir menos señales internas, menos descubrimiento y menos frecuencia de rastreo.

Si tus páginas activas o "money pages" aparecen a demasiados clics de distancia, toca reorganizar:

- crea hubs temáticos

- enlaza desde categorías y páginas madre

- añade un sitemap HTML para colecciones profundas cuando haga falta

- evita depender solo de buscadores internos o filtros JS

Plan de acción rápido para mejorar el crawl budget

Si quieres una secuencia práctica, sería esta:

- Revisa Search Console para detectar grupos de URLs problemáticos.

- Analiza logs si el sitio ya tiene volumen suficiente.

- Corrige 4xx, 5xx y cadenas de redirección.

- Reduce duplicados y afina canonicals.

- Limpia parámetros y trampas de rastreo.

- Refuerza enlaces internos hacia páginas clave.

- Mantén el sitemap alineado con lo que sí quieres indexar.

- Actualiza o consolida páginas con valor real; elimina el resto.

En resumen

Optimizar el crawl budget no consiste en "conseguir más rastreo" por sí mismo. Consiste en quitarle trabajo inútil a Google para que gaste más tiempo donde realmente te interesa.

Haz más fácil el rastreo de tus páginas importantes, reduce el ruido técnico y deja de publicar o mantener URLs que no aportan nada. Ahí es donde normalmente se nota la mejora.