不是每個網站都需要把「抓取預算」當成頭號 SEO 問題。如果你的網站規模不大、URL 結構乾淨,新頁面也總是很快被 Google 發現,那麼通常還有其他更值得先處理的事。

但一旦網站開始出現大量篩選頁、參數頁、舊重定向、內容薄弱頁、重複頁,情況就會不一樣。Googlebot 會把時間花在不該花的地方,真正重要的頁面反而得不到足夠關注。

說穿了,抓取預算優化不是為了追求「更多抓取」,而是為了減少浪費。

抓取預算實際上在講什麼

Google 很早就說過,所謂 crawl budget 並不是一個單獨的官方指標。但在實務上,它確實存在,而且很好理解:Google 不可能用同樣的頻率與同樣的優先權去抓每一個 URL。

通常是兩股力量一起作用:

- 你的伺服器能承受多少穩定抓取

- Google 認為哪些 URL 值得更常回訪

如果網站速度夠快、架構夠清楚、優先層級夠明確,抓取通常不會太亂。反過來說,網站噪音越多,抓取就越容易被稀釋。

哪些網站特別需要在意

這類情況通常最容易出問題:

- 有很多篩選條件的電商網站

- 大型目錄、Marketplace、資料庫型網站

- 舊內容很多的部落格或媒體站

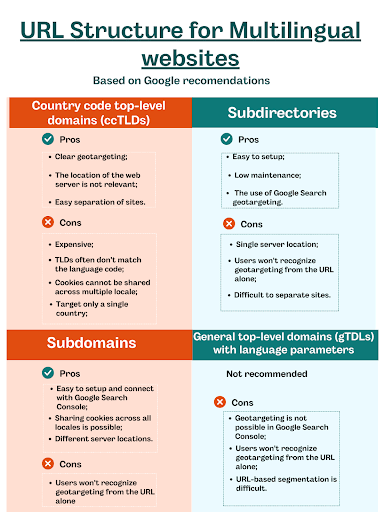

- 多語系、多地區版本網站

- 高度依賴 JavaScript 的專案

- 改版或搬站後留下不少舊 URL 問題的網站

如果你已經看到下面這些訊號,就更該開始處理:

- 重要頁面收錄很慢

- Search Console 顯示大量抓取落在次要 URL

- Server log 裡有很多 404、5xx 或重定向鏈

- Google 常抓雜訊頁,卻不常回來看核心頁

抓取預算最常浪費在哪裡

多數時候,浪費都來自一些很典型的問題。

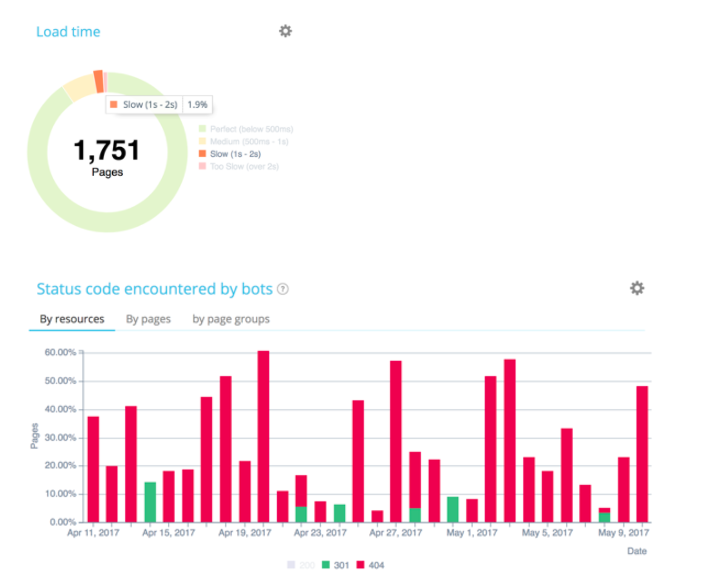

1. 伺服器回應太慢

如果 TTFB 高,或伺服器一忙就不穩,Google 通常會自己把抓取節奏放慢。

2. 大量錯誤與重定向

4xx、5xx,以及 A -> B -> C 這種重定向鏈,會把抓取資源耗在沒有價值的路徑上。

3. 重複或近似重複 URL

像是篩選參數、排序頁、追蹤參數、HTTP/HTTPS 重複版本、canonical 設錯,都很容易把抓取面積不必要地放大。

4. 內部連結結構太弱

如果頁面藏得太深,Google 會自然認為它不是優先項目。

5. 蜘蛛陷阱

無限日曆、無限制組合的 faceted pages、可索引的站內搜尋頁、沒有價值的動態路由,都是常見例子。

先處理技術健康與速度

在想著怎麼「增加抓取」之前,更務實的做法是先把現有浪費清掉。

- 降低 TTFB

- 清除不必要的重定向

- 修掉持續出現的 4xx 與 5xx

- 確保重要的 CSS、JS、圖片都能正常回 200

- 檢查

robots.txt沒有擋到該開放的資源

你可以先用 SEO Analyzer 快速抓出網站裡反覆出現的技術問題。如果連 Robots 規則本身都亂了,則可以順手用 Robots.txt 產生器 重新整理。

讓 Google 更清楚哪些頁面才重要

Google 不會因為你覺得某頁重要,就自動把它當成高優先。它看的是結構和訊號。

把核心頁面往前拉

真正有流量價值、商業價值、轉換價值的頁面,不應該被埋在很深的層級裡。

- 從分類頁或主題 Hub 給它更多連結

- 讓高權重頁面導向它

- 不要只靠零散的文內連結支撐它

讓 Sitemap 保持精簡且有選擇

XML Sitemap 不是把所有存在的 URL 全塞進去。它應該反映你真正希望被抓、被收錄的頁面集合。如果目前很混亂,可以用 Sitemap 產生器 重新整理。

找出孤島頁面

孤島頁可能還是會被 Google 透過舊連結或 Sitemap 找到,但因為沒有內部連結支撐,它在整體結構裡的地位會偏低。如果它還能帶來流量,那就更值得修復。

Canonical 與重複內容,是最容易被忽略的浪費點

很多抓取浪費不是因為頁面太少,而是因為版本太多。

優先檢查:

- 篩選與排序頁

- 行銷活動參數 URL

- 有沒有 slash 的重複頁

- HTTP 與 HTTPS 並存

- 太相似的分類頁或內容頁

如果 Google 需要反覆抓多個版本,最後卻只收其中一個,這就是標準的浪費。這類訊號可以用 Canonical Tag Generator 先檢查一輪。

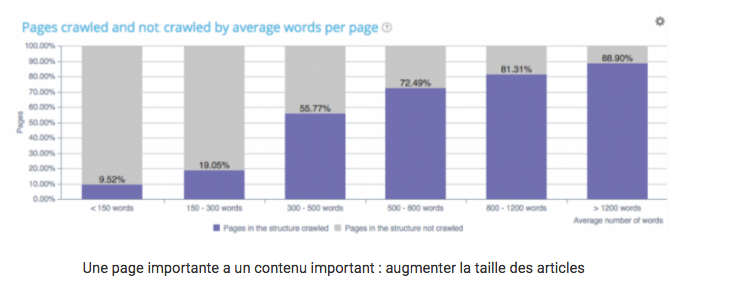

內容本身也會影響抓取頻率

Google 不只看技術面,它也會判斷這個頁面值不值得常回來看。

內容過薄、重複度高、長期沒維護的頁面,通常不容易得到高頻回訪。相對地,內容完整、持續更新、能解決搜尋意圖的頁面,更容易被認為值得重抓。

這不表示每頁都要硬湊字數,而是要:

- 合併弱而重複的頁面

- 更新真正重要的核心頁

- 把沒有價值的 URL 刪除或重定向

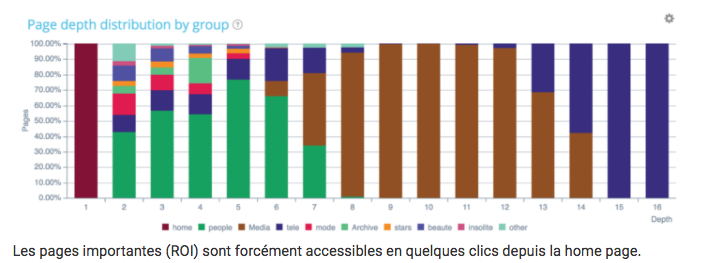

頁面深度仍然是很重要的訊號

如果一個頁面離首頁要點十幾下才到,Google 很難把它看成真正的重點頁面。

如果你的活躍頁或「賺錢頁」藏得太深,建議重新調整:

- 建立主題型 Hub

- 強化分類頁作為流量分配節點

- 深層頁面群組可加上 HTML Sitemap

- 不要把關鍵內容只藏在站內搜尋或 JS 篩選後面

一個實際可執行的處理順序

- 先看 Search Console 的抓取資料。

- 網站規模夠大時,分析 Server log。

- 修正錯誤碼與重定向鏈。

- 清理重複 URL 並校正 canonical。

- 降低參數垃圾與蜘蛛陷阱。

- 強化通往核心頁的內部連結。

- 讓 Sitemap 與實際優先順序一致。

- 更新強頁、合併弱頁、淘汰沒價值的頁。

最後整理

抓取預算優化,真正要做的不是讓 Google「更努力」,而是讓它少走冤枉路,把時間花在你最重要的頁面上。

少一點技術噪音、少一點重複 URL、清楚一點頁面優先層級,通常就能看到很明顯的改善。