Проблема большинства AI-статей не в том, что их пишет искусственный интеллект. Проблема в том, что AI ставят не на то место в процессе. Ему поручают быстро выдать текст, а вопросы, от которых реально зависит SEO, остаются без ответа: стоит ли вообще брать этот запрос, какой тип страницы должен его закрывать, хватает ли сайту авторитета, не будет ли новая страница каннибализировать уже существующую, и есть ли у этой публикации шанс привести не только трафик, но и заявки.

Когда этот порядок меняется, меняется и результат. В одном производственном проекте мы пришли на сайт с устаревшей структурой, дублирующимися продуктовыми страницами и маленькой контент-командой. Через полгода органический трафик вырос на 300%, а входящие обращения на 150%. Причина была не в том, что мы начали "массово писать с AI". Причина была в том, что мы встроили AI внутрь нормального SEO-воркфлоу.

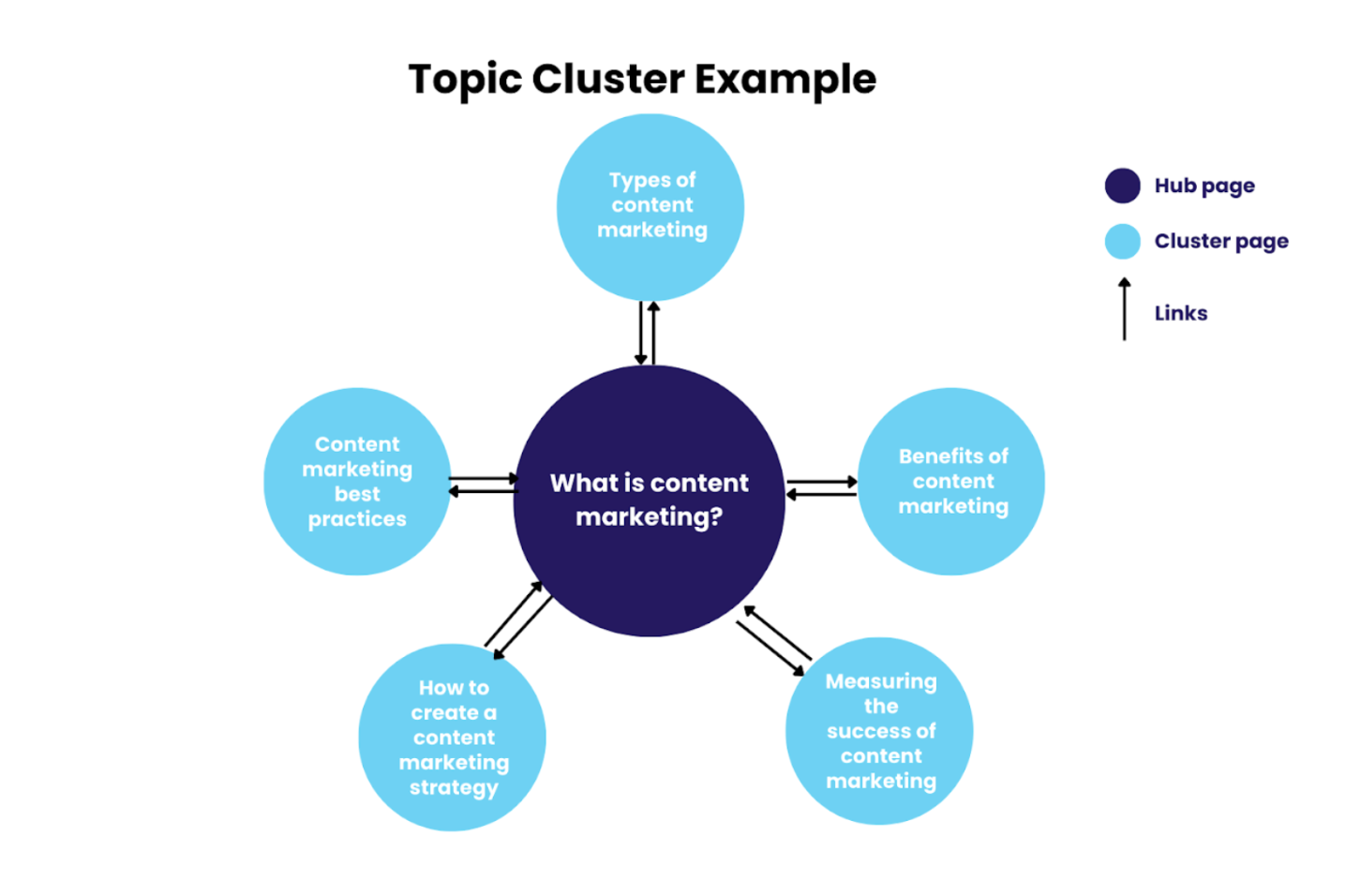

Если использовать AI правильно, он помогает не только с черновиком. Он расширяет семантическое покрытие, подсказывает недостающие подтемы и усиливает внутреннюю перелинковку вокруг основной страницы.

Если использовать AI правильно, он помогает не только с черновиком. Он расширяет семантическое покрытие, подсказывает недостающие подтемы и усиливает внутреннюю перелинковку вокруг основной страницы.

Почему рост AI-контента почти не гарантирует рост SEO

Типичный сценарий выглядит знакомо. Команда находит привлекательный ключ, сразу генерирует статью, публикует ее как можно быстрее и только потом замечает, что интент у запроса вообще-то был не блоговый.

Отсюда и появляются повторяющиеся проблемы:

- под одну и ту же интентную группу создается несколько URL

- текст звучит гладко, но не отвечает на реальный вопрос пользователя

- статья охватывает тему широко, но без доказательств, примеров и отраслевого языка

- перед публикацией никто не дожимает title, description, внутренние ссылки, schema и CTA

Поэтому вопрос не в том, "умеет ли AI писать". Вопрос в том, кто и когда принимает ключевые решения.

Правильная роль AI: не автопилот, а второй стратегический слой

Я бы не делал из AI главного автора. Зато как инструмент для анализа и ускорения он очень силен.

Он полезен, когда нужно:

- сгруппировать запросы по интенту

- быстро увидеть пробелы в теме

- предложить FAQ-вопросы

- расширить карту сущностей и связанных терминов

- ускорить структуру и первый черновик

Но есть зоны, которые лучше не отдавать ему без контроля:

- выбор URL и типа страницы

- продуктовый акцент и коммерческий посыл

- проверка фактов и доказательств

- локальный тон и формулировки, которые звучат живо, а не шаблонно

AI ускоряет. Человеческое решение держит страницу в правильной траектории.

Воркфлоу AI + SEO, который реально сработал

1. Сначала определить интент и роль страницы

До любого промпта надо ответить на базовые вопросы:

- стоит ли брать этот запрос в работу прямо сейчас

- соответствует ли он текущей силе сайта и продуктовой логике

- должен ли его закрывать блог, tool page или service page

- нет ли уже близкого URL, который должен быть главным

На этом этапе хорошо помогают /optimize и /seo. Первый заставляет смотреть на ключ как на задачу с приоритетом и целью. Второй показывает, где существующие страницы уже проседают.

Если пропустить этот этап, AI просто поможет вам быстрее выпустить не ту страницу.

2. Сделать семантический бриф до текста

Сильный SEO-материал начинается не с команды "напиши статью", а с качественного брифа.

В нем мы обычно фиксируем:

- основной запрос

- естественные long-tail-варианты

- вопросы, которые пользователь действительно хочет закрыть

- сущности и связанные термины

- доказательства, примеры, цифры

- внутренние ссылки, которые нужно усилить

- CTA под конкретную стадию воронки

Именно здесь AI часто особенно полезен: он быстро расширяет карту подтем и помогает не оставить материал слишком плоским.

3. Генерировать быстро, но публиковать только после человеческой доработки

Когда бриф готов, AI можно использовать для ускорения:

- вариантов захода в тему

- H2-структуры

- FAQ-блока

- таблиц и объясняющих секций

Но дальше начинается работа редактора. Проверка фактуры. Удаление пустых формулировок. Добавление реального опыта. Настройка тона под локальную аудиторию. Если материал звучит как усредненная генерация, он может быть читабельным, но доверия не добавит.

4. Перед публикацией дожать CTR и технический SEO-слой

Даже хороший текст легко проигрывает SERP, если команда не закрыла базовые вещи:

- слабый title

- шаблонная meta description

- размытые подзаголовки

- мало внутренних ссылок

- нет осмысленного alt у изображения

- нет структурированных данных

- CTA либо слабая, либо спрятана слишком глубоко

Поэтому этот материал логично читать вместе с воркфлоу по title, description и кликабельности и гайдом по prepublish QA для AI-контента. На этом этапе черновик превращается в актив.

5. После публикации работать с URL как с живым SEO-активом

Публикация ничего не завершает. Она только запускает фазу обратной связи.

У нас обычно такой ритм:

- в первые 24 часа: индексация, рендер, ошибки, метаданные

- в первые 7 дней: показы, стартовый CTR, первые сдвиги по позициям

- в первые 30 дней: полезный трафик, поведение, конверсии

Если страница получает показы, но не клики, переписываются title и description. Если клики есть, а лидов нет, меняются CTA, структура и доказательная часть. Если материал устаревает, его переводят в workflow обновления контента.

Что изменилось в реальном кейсе

Стартовая картина была тяжелой. Более 67% title были дублирующимися. У 42% страниц отсутствовала meta description. На сайте накопилось 156 ошибок 404. Около 40% product page слишком сильно пересекались по содержанию. Из более чем 2.000 URL заметный органический трафик давали меньше 50 страниц.

Мы не стали просто штамповать новые статьи. Вместо этого:

- собрали матрицу из 2.500 ключей по интенту, стадии воронки и коммерческой ценности

- перестроили логику topic cluster и pillar page

- ввели тройную проверку: техника, редактура, бизнес

- отдали AI исследование, структуру, семантическое покрытие и первый черновик

- оставили команде финальную проверку, локальный язык и смысловой акцент

Именно это дало рост. Не скорость ради скорости, а управляемая интеграция.

Ошибки, которые особенно часто убивают AI SEO-проекты

- превращать каждый найденный ключ в новую статью

- позволять AI решать, какой тип страницы нужен

- смотреть только на позиции и игнорировать конверсии

- публиковать текст без повторной проверки на точность, тон и пересечения

Это тихие ошибки. Они редко выглядят как авария, но месяцами выедают результат.

С чего я бы начал сегодня

- Сначала разобрал бы URL, которые уже конкурируют друг с другом.

- Потом выбрал бы небольшую группу запросов с ясным интентом и понятной бизнес-ценностью.

- После этого запустил бы пилот из 5-10 страниц с семантическим брифом, QA и ревью через 30 дней.

Так очень быстро становится видно, где у команды настоящий узкий участок: в производстве, архитектуре сайта или в конверсии.

FAQ по AI-контенту и SEO

Может ли AI-контент ранжироваться в Google?

Да. Но не потому, что он написан AI, а потому что он точно закрывает интент, дает убедительные сигналы качества, встроен в структуру сайта и технически выпущен без дыр.

Нужно ли превращать все найденные через AI ключи в статьи?

Нет. Часть запросов логичнее закрывать инструментом, service page или уже существующим URL. Если отправлять все в блог, архитектура быстро расползется.

Что важно смотреть в первый месяц после публикации?

Сначала индексацию и техническую чистоту. Потом показы, CTR и первые движения по позициям. Затем качество трафика, поведение и конверсии.

Что полезно открыть дальше

- AI SEO Content Workflow: как превращать черновики в поисковые активы

- QA AI-контента перед публикацией

- Как переписать title и description, чтобы получить больше кликов

- Когда обновлять контент, чтобы вернуть трафик

Если вы уже строите этот процесс у себя, имеет смысл связать его с /seo, /optimize, /ai/article-generator и /ai/rewrite, чтобы исследование, генерация, QA и рост конверсии не существовали отдельно друг от друга.