معظم عمليات تدقيق SEO لا تفشل لأن الفريق لم يعمل، بل لأنها تبدأ بإصلاح أول مشكلة تبدو واضحة.

العنوان يبدو ضعيفاً، فيعيد أحدهم كتابة الميتا. الصفحة الرئيسية بطيئة، فيبدأ الفريق التقني مطاردة أجزاء من الثانية. بعض الروابط لا تدخل الفهرس، فيعاد تحرير النص. وبعد أسبوع يكون الجميع قد انشغل فعلاً، لكن أحداً لا يملك جواباً واضحاً عن السؤال الأهم: ما الذي يعيق هذا الموقع فعلاً الآن؟

إذا كان موقعك يعمل منذ فترة لكن النمو ما زال عالقاً، فأنت لا تحتاج إلى قائمة أطول. أنت تحتاج إلى ترتيب. التدقيق الجيد يفعل شيئين بوضوح:

- يكشف العوائق الحقيقية، لا الأعراض الأعلى صوتاً فقط.

- يفرّق بين ما يجب إصلاحه الآن، وما يأتي بعده، وما يمكن تأجيله.

الوظيفة الأولى لأي تدقيق ليست جمع كل الملاحظات الممكنة، بل فصل ما يوقف الزحف والفهرسة فعلاً عن التفاصيل التي لا تظهر قيمتها إلا بعد ضبط الأساسيات.

لماذا تصنع كثير من تدقيقات SEO حركة بلا تقدّم

التدقيق الضعيف ينتهي غالباً بقائمة مسطّحة:

- عناوين مكررة

- صفحات تفتقد H1

- صور بلا alt

- روابط كثيرة تعيد التوجيه

- صفحات مهمة غير مفهرسة

- ربط داخلي ضعيف

- صفحات قالب متشابهة أكثر من اللازم

كل هذه المشاكل قد تكون حقيقية. المشكلة أن وزنها ليس واحداً.

إذا كان الموقع يفقد إشاراته بسبب canonical خاطئ، أو مسارات اكتشاف مكسورة، أو noindex نُشر بالخطأ، فإن تحسين العناوين الفرعية ليس استراتيجية SEO. هو مجرد انشغال مكلف لا يمس أصل المشكلة.

قبل أن تعتبر أي تدقيق مكتملًا، يجب أن يجيب على ثلاثة أسئلة:

- ما المشكلات التي تؤثر مباشرة في الزحف والفهرسة؟

- ما المشكلات التي تحد من قدرة الصفحة على الترتيب حتى لو كانت قابلة للفهرسة؟

- ما المشكلات التي تُعد تنظيفاً وتحسيناً ثانوياً ولا ينبغي أن تخطف الأولوية؟

الترتيب الذي يجعل تدقيق الموقع مفيداً فعلاً

حين أطبق هذا داخل SeoSpeedup، لا أبدأ بإعادة كتابة النص. أنا أراجع الموقع عبر أربع طبقات.

1. التأكد أولاً من أن محركات البحث تستطيع الدخول والزحف والاحتفاظ بالصفحات الصحيحة

هذه طبقة الأساس:

- هل تعيد الروابط المهمة حالة

200 OKنظيفة؟ - هل توجد سلاسل إعادة توجيه أو كثرة

302أو روابط ميتة في المسارات الحساسة؟ - هل ملف

robots.txtقابل للقراءة ومنطقي؟ - هل يتضمن XML Sitemap الصفحات التي تهم فعلاً؟

- هل canonical يشير إلى الصفحة نفسها حيث يجب ذلك؟

- هل خرج

noindexإلى صفحات أساسية بالخطأ؟

هنا تظهر قيمة SEO Analyzer. أنت لا تحاول التحسين بعد. أنت تتحقق من أن الموقع مؤهل أصلاً للدخول في المنافسة.

إذا كانت قواعد الزحف مرتبكة، فقارنها عبر Robots.txt Generator، وأعد تنظيم مسارات الاكتشاف عبر Sitemap Generator، وراجع منطق canonical عبر Canonical Tag Generator.

إذا كانت الفهرسة نفسها مضطربة، فالأفضل قراءة الصفحة غير مفهرسة؟ ابدأ بالتشخيص قبل إعادة الكتابة قبل أن يضيع الفريق جولة أخرى في تعديل النص بينما أصل المشكلة تقني.

2. فحص ما إذا كانت بنية الصفحة منطقية تقنياً

بعد ضبط الوصول والفهرسة، انزل إلى مستوى الصفحة نفسها.

راجع:

- Title و Description المفقودين أو المكررين

- هيكل العناوين المكسور

- تعارض الإشارات بين canonical أو hreflang أو pagination

- ضعف البنية الدلالية

- مشاكل العرض على الجوال

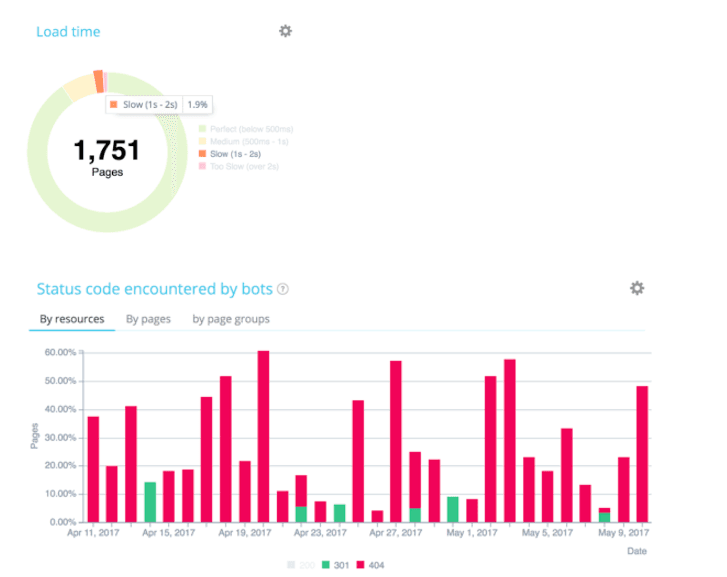

- Core Web Vitals أو اختناقات الأداء الواضحة

كثير من الفرق تبدأ من هنا بحكم العادة. هذا مقبول فقط إذا كانت الخطوة الأولى محسومة. غير ذلك فأنت تلمّع لوحة القيادة بينما ضوء المحرك ما زال مضاءً.

إذا كنت تتعامل مع إطلاق جديد أو إعادة بناء، فمن المفيد قراءة قائمة فحص SEO قبل الإطلاق إلى جانب هذه المرحلة.

3. فحص ما إذا كانت الصفحة تستحق الترتيب من الأصل

السلامة التقنية ليست خط النهاية. هناك صفحات قابلة للزحف والفهرسة، لكنها ما تزال أضعف من أن تنافس.

هنا يجب أن تسأل:

- هل الصفحة تجيب فعلاً عن الاستعلام أم أنها مجرد صفحة طويلة؟

- هل توجد عدة روابط تتنافس على النية نفسها؟

- هل صفحات القوالب تكرر البنية الضعيفة نفسها؟

- هل لدى الصفحة ربط داخلي كافٍ وسياق موضوعي واضح؟

- هل النية تجارية أم معلوماتية أم تنقلية، وهل تنسيق الصفحة مناسب لها؟

إذا كانت الصفحة بالكاد تُكتشف من داخل الموقع، فأصلح هذا قبل أن تنتظر تحركاً في الترتيب. والقراءة المكملة هنا هي كيف تستخدم الربط الداخلي لدعم الصفحة الصحيحة.

4. تحويل النتائج إلى ترتيب إصلاح، لا إلى جدار من الملاحظات

هذه هي الخطوة التي تتجاوزها فرق كثيرة، ولهذا تموت تقارير التدقيق داخل عرض شرائح.

أنا أقسم النتائج إلى ثلاث طبقات.

P0: مشكلات توقف الزحف أو الفهرسة أو الوصول

أمثلة:

- تعليمات خاطئة في

robots.txt - canonical يشير إلى الرابط الخطأ

- صفحات أساسية تحمل

noindex - أخطاء في Sitemap

- مجموعات كبيرة من الروابط الأساسية المكسورة أو المعاد توجيهها

- دخول النسخ المكررة إلى الفهرس بدلاً من النسخة المفضلة

هذه تأتي أولاً لأنها تحدد ما إذا كان Google قادراً أصلاً على إدخال الصفحات الصحيحة إلى مجموعة الصفحات المنافسة.

P1: مشكلات تحد من القدرة على الترتيب

أمثلة:

- محتوى ضعيف أو بعيد عن نية البحث

- بنية صفحة فوضوية

- ربط داخلي خفيف

- مشاكل تجربة الجوال

- قوالب ثقيلة تضعف العرض أو التفاعل

- صفحات متكررة بلا تمايز كافٍ

هذه لا تمنع الفهرسة غالباً، لكنها تضع سقفاً منخفضاً لما يمكن أن تصل إليه الصفحة.

P2: تحسينات موضعية ولمسات نهائية

أمثلة:

- alt مفقود في بعض الصور

- تنظيف بسيط لـ schema

- تعديلات خفيفة على النص

- توحيد لغة CTA

- تحسينات ثانوية في metadata

هي مهمة أيضاً، لكنها لا تستحق أن تتجاوز العوائق العامة في الطابور.

كيف تحوّل التدقيق إلى عمل قابل للتنفيذ داخل الفريق

التدقيق يبدأ في اكتساب قيمة حقيقية عندما يتحول إلى مسؤوليات واضحة.

| نوع المشكلة | النطاق | الأولوية | المسؤول | المهلة المقترحة |

|---|---|---|---|---|

| التحكم في الزحف / الفهرسة | الموقع كله أو الأقسام الأساسية | P0 | الهندسة / SEO التقني | 24 إلى 72 ساعة |

| بنية الصفحة / منطق القالب | مستوى القسم أو القالب | P1 | الواجهة الأمامية / SEO | 3 إلى 7 أيام |

| جودة المحتوى / نية البحث | صفحة أو عنقود محتوى | P1 | المحتوى / SEO | من أسبوع إلى أسبوعين |

| التنظيف / التحسين | تفاصيل على مستوى الصفحة | P2 | SEO / التحرير | بشكل مستمر |

هذا التقسيم يفيد في نقطتين:

- يجعل SEO خطة تنفيذ، لا نصائح عامة.

- يضع المنتج والهندسة والمحتوى والنمو أمام قائمة أولوية واحدة.

إذا أردت ربط التشخيص بالتنفيذ، فابدأ من SEO Analyzer، ثم انقل الصفحات التي ما زالت تملك فرصة إلى Keyword Optimization Service. هكذا تسير الإصلاحات التقنية وعمل الترتيب بالتوازي بدل أن يتعطلا معاً.

أين تساعد AI في التدقيق وأين لا تكفي

الذكاء الاصطناعي مفيد في التدقيق، لكن بعد تثبيت الحقائق أولاً.

استخدمه في:

- تلخيص الأنماط عبر عدد كبير من الروابط

- شرح أهمية المشكلة بلغة واضحة

- تحويل النتائج إلى ملاحظات تنفيذية للمطورين أو المحررين

- مقارنة صيغ Title و Description

ولا تعتمد عليه وحده لتحديد:

- ما إذا كانت الصفحة قابلة للزحف فعلاً

- ما هو status code الحقيقي في بيئة الإنتاج

- ماذا يطبع canonical أو robots بالفعل

- هل Sitemap صالح أم لا

- كيف يختبر المستخدمون والبوتات الصفحة في الواقع

الترتيب الأفضل بسيط: اجمع الأدلة أولاً، ثم استخدم AI لتسريع الشرح والتنفيذ.

زاوية التدقيق تختلف حسب نوع الموقع

المواقع الجديدة

التركيز الأول يجب أن يكون على الاكتشاف والاستعداد للفهرسة:

- هل توجد مداخل واضحة للزواحف؟

- هل الصفحات المهمة موجودة في Sitemap؟

- هل metadata وcanonical والقوالب الأساسية مستقرة؟

مواقع إعادة التصميم أو الترحيل

التركيز الأول يجب أن يكون على الاستمرارية:

- هل جرى ربط الروابط القديمة بالبنية الجديدة بشكل صحيح؟

- هل صمدت التحويلات وcanonical والربط الداخلي بعد الإطلاق؟

- هل الصفحات المفهرسة سابقاً ما زالت قابلة للوصول ومفيدة؟

المواقع متعددة اللغات

التركيز الأول يجب أن يكون على اتساق الإشارات:

- هل علاقات

hreflangصحيحة؟ - هل canonical يبقى داخل النسخة اللغوية الصحيحة؟

- هل كل لغة تستهدف نية مختلفة بوضوح أم أن الصفحات تأكل بعضها بعضاً؟

الخلاصة

تدقيق SEO للموقع ليس مسابقة لمعرفة من يعثر على أكبر عدد من الأخطاء.

هو تمرين على ترتيب الأولويات. الفائدة الحقيقية تأتي من معرفة المشكلات القليلة التي تخنق الزحف والفهرسة والقدرة على الترتيب الآن، ثم إصلاحها بالترتيب الصحيح.

إذا كان موقعك عالقاً، فلا تبدأ بإعادة كتابة صفحات عشوائية. ابدأ بالتشخيص الكامل عبر SEO Analyzer. وبعدما تستقر القاعدة، استخدم Keyword Optimization Service لتحديد الصفحات التي تستحق الجولة التالية من العمل على المحتوى والترتيب.

هذا هو الفرق بين أن تكون “تعمل في SEO” وبين أن تزيل فعلاً الاختناقات التي تمنع الموقع من النمو.